Как отмечено в предыдущем разделе, изучение

классических алгоритмов во многих

случаях может быть проведено с помощью

асимптотических методов математической

статистики, в частности, с помощью ЦПТ

и методов наследования сходимости . Отрыв классической математической

статистики от нужд прикладных исследований

проявился, в частности, в том, что в

распространенных монографиях недостает

математического аппарата, необходимого,

в частности, для изучения двухвыборочных

статистик. Суть в том, что переходить к

пределу приходится не по одному параметру,

а по двум – объемам двух выборок. Пришлось

разработать соответствующую теорию –

теорию наследования сходимости,

изложенную в нашей монографии .

Однако

применять результаты подобного изучения

придется при конечных объемах выборок.

Возникает целый букет проблем, связанных

с таким переходом. Часть из них обсуждалась

в в связи с изучением свойств статистик,

построенных по выборкам из конкретных

распределений.

Однако

при обсуждении влияния отклонений от

исходных предположений на свойства

статистических процедур возникают

дополнительные проблемы. Какие отклонения

считать типичными? Ориентироваться ли

на наиболее «вредные» отклонения,

в наибольшей степени искажающие свойства

алгоритмов, или же сосредоточить внимание

на «типичных» отклонениях?

При

первом подходе получаем гарантированный

результат, но «цена» этого результата

может быть излишне высокой. В качестве

примера укажем на универсальное

неравенство Берри-Эссеена для погрешности

в ЦПТ . Совершенно справедливо

подчеркивает А.А. Боровков , что

«скорость сходимости в реальных

задачах, как правило, оказывается лучше.»

При

втором подходе возникает вопрос, какие

отклонения считать «типичными».

Попытаться ответить на этот вопрос

можно, анализируя большие массивы

реальных данных. Вполне естественно,

что ответы различных исследовательских

групп будут различаться, как это видно,

например, по результатам, приведенным

в статье .

Одна

из ложных идей — использование при

анализе возможных отклонений только

какого-либо конкретного параметрического

семейства – распределений Вейбулла-Гнеденко,

трехпараметрического семейства гамма

— распределений и др. Еще в 1927 г. акад. АН

СССР С.Н. Бернштейн обсуждал методологическую

ошибку, состоящую в сведении всех

эмпирических распределений к

четырехпараметрическому семейству

Пирсона . Однако и до сих пор

параметрические методы статистики

весьма популярны, особенно среди

прикладников, и вина за это заблуждение

лежит прежде всего на преподавателях

статистических методов (см. ниже, а также

статью ).

15. Выбор одного из многих критериев для проверки конкретной гипотезы

Во

многих случаях для решения конкретной

практической задачи разработано много

методов, и специалист по математическим

методам исследования стоит перед

проблемой: какой из них предложить

прикладнику для анализа конкретных

данных?

В

качестве примера рассмотрим задачу

проверки однородности двух независимых

выборок. Как известно , для ее решения

можно предложить массу критериев:

Стьюдента, Крамера-Уэлча, Лорда, хи —

квадрат, Вилкоксона (Манна-Уитни), Ван

– дер — Вардена, Сэвиджа, Н.В.Смирнова,

типа омега-квадрат (Лемана-Розенблатта),

Г.В.Мартынова и др. Какой выбрать?

Естественным

образом приходит в голову идея

«голосования»: провести проверку

по многим критериям, а затем принять

решение «по большинству голосов».

С точки зрения статистической теории

такая процедура приводит попросту к

построению еще одного критерия, который

априори ничем не лучше прежних, но более

труден для изучения. С другой стороны,

если совпадают решения по всем

рассмотренным статистическим критериям,

исходящим из различных принципов, то в

соответствии с концепцией устойчивости

это повышает доверие к полученному

общему решению.

Распространено,

особенно среди математиков, ложное и

вредное мнение о необходимости поиска

оптимальных методов, решений и т.д. Дело

в том, что оптимальность обычно исчезает

при отклонении от исходных предпосылок.

Так, среднее арифметическое в качестве

оценки математического ожидания является

оптимальной только тогда, когда исходное

распределение — нормальное , в то время

как состоятельной оценкой — всегда, лишь

бы математическое ожидание существовало.

С другой стороны, для любого произвольно

взятого метода оценивания или проверки

гипотез обычно можно так сформулировать

понятие оптимальности, чтобы рассматриваемый

метод стал оптимальным – с этой специально

выбранной точки зрения. Возьмем, например,

выборочную медиану как оценку

математического ожидания. Она, разумеется,

оптимальна, хотя и в другом смысле, чем

среднее арифметическое (оптимальное

для нормального распределения). А именно,

для распределения Лапласа выборочная

медиана является оценкой максимального

правдоподобия, а потому оптимальной (в

смысле, уточненном в монографии ).

Критерии

однородности были проанализированы в

монографии . Естественных подходов

к сравнению критериев несколько — на

основе асимптотической относительной

эффективности по Бахадуру, Ходжесу-Леману,

Питмену. И выяснилось, что каждый критерий

является оптимальным при соответствующей

альтернативе или подходящем распределении

на множестве альтернатив. При этом

математические выкладки обычно используют

альтернативу сдвига, сравнительно редко

встречающуюся в практике анализа

реальных статистических данных (в связи

с критерием Вилкоксона эта альтернатива

обсуждалась и критиковалась нами в

). Итог печален — блестящая математическая

техника, продемонстрированная в , не

позволяет дать рекомендации для выбора

критерия проверки однородности при

анализе реальных данных. Другими словами,

с точки зрения работы прикладника, т.е.

анализа конкретных данных, монография

бесполезна. Блестящее владение

математикой и огромное трудолюбие,

продемонстрированные автором этой

монографии, увы, ничего не принесли

практике.

Конечно,

каждый практически работающий статистик

так или иначе решает для себя проблему

выбора статистического критерия. На

основе ряда методологических соображений

мы остановили свой выбор на состоятельном

против любой альтернативы критерии

типа омега-квадрат (Лемана-Розенблатта).

Однако остается чувство неудовлетворенности

в связи с недостаточной обоснованностью

этого выбора.

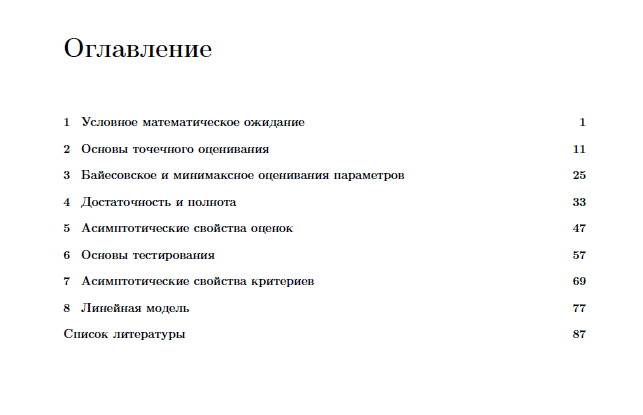

В современных условиях интерес к анализу данных постоянно и интенсивно растет в совершенно различных областях, таких как биология, лингвистика, экономика, и, разумеется, IT. Основу этого анализа составляют статистические методы, и разбираться в них необходимо каждому уважающему себя специалисту в data mining.

К сожалению, действительно хорошая литература, такая что умела бы предоставить одновременно математически строгие доказательства и понятные интуитивные объяснения, встречается не очень часто. И данные лекции , на мой взгляд, необычайно хороши для математиков, разбирающихся в теории вероятностей именно по этой причине. По ним преподают магистрам в немецком университете имени Кристиана-Альбрехта на программах «Математика» и «Финансовая математика». И для тех, кому интересно, как этот предмет преподается за рубежом, я эти лекции перевел . На перевод у меня ушло несколько месяцев, я разбавил лекции иллюстрациями, упражнениями и сносками на некоторые теоремы. Замечу, что я не профессиональный переводчик, а просто альтруист и любитель в этой сфере, так что приму любую критику, если она конструктивна.

Вкратце, лекции вот о чем:

Условное математическое ожидание

Эта глава не относится непосредственно к статистике, однако, идеальна для старта её изучения. Условное математическое ожидание — это наилучший выбор для предсказания случайного результата на основе уже имеющейся информации. И это тоже случайная величина. Здесь рассматриваются его различные свойства, такие как линейность, монотонность, монотонная сходимость и прочие другие.

Основы точечного оценивания

Как оценить параметр распределения? Какой для этого выбрать критерий? Какие методы при этом использовать? Эта глава позволяет ответить на все эти вопросы. Здесь вводятся понятия несмещенной оценки и равномерно несмещенной оценки с минимальной дисперсией. Объясняется, откуда берутся распределение хи-квадрат и распределение Стьюдента, и чем они важны при оценивании параметров нормального распределения. Рассказывается, что такое неравенство Рао-Крамера и информация Фишера. Также вводится понятие экспоненциального семейства, многократно облегчающего получение хорошей оценки.

Байесовское и минимаксное оценивания параметров

Здесь описывается иной философский подход к оценке. В данном случае параметр считается неизвестным потому, что он является реализацией некой случайной величины с известным (априорным) распределением. Наблюдая результат эксперимента мы рассчитываем так называемое апостериорное распределение параметра. На основе этого, мы можем получить Байесовскую оценку, где критерием является минимум потерь в среднем, или минимаксную оценку, минимизирующую максимально возможные потери.

Достаточность и полнота

Эта глава имеет серьезное прикладное значение. Достаточная статистика — это функция от выборки, такая что достаточно хранить только результат этой функции для того, чтобы оценить параметр. Таких функций много и среди них выделяют так называемые минимальные достаточные статистики. Например, для оценки медианы нормального распределения достаточно хранить лишь одно число — среднее арифметическое по всей выборке. Работает ли это также для других распределений, например, для распределения Коши? Как достаточные статистики помогают в выборе оценок? Здесь вы можете найти ответы на эти вопросы.

Асимптотические свойства оценок

Пожалуй, самое важное и необходимое свойство оценки — это её состоятельность, то есть стремление к истинному параметру при увеличении размера выборки. В этой главе рассказывается какими свойствами обладают известные нам оценки, полученные описанными в предыдущих главах статистическими методами. Вводятся понятия асимптотической несмещенности, асимптотической эффективности и расстояния Кульбака-Лейблера.

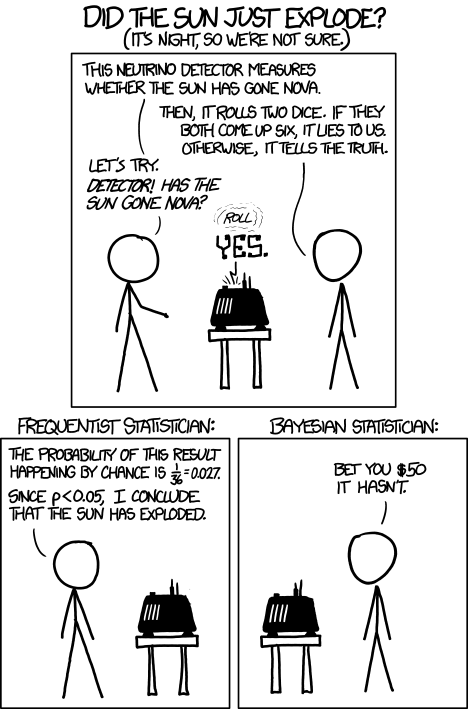

Основы тестирования

Кроме вопроса о том, как оценить неизвестный нам параметр, мы должны каким-то образом проверить, удовлетворяет ли он требуемым свойствам. Например, проводится эксперимент, в ходе которого испытывается новое лекарство. Как узнать, выше ли вероятность выздоровления с ним, нежели чем с использованием старых лекарств? В этой главе объясняется, как строятся подобные тесты. Вы узнаете, что такое равномерно наиболее мощный критерий, критерий Неймана-Пирсона, уровень значимости, доверительный интервал, а также откуда берутся небезызвестные критерий Гаусса и t-критерий.

Асимптотические свойства критериев

Как и оценки, критерии должны удовлетворять определенным асимптотическим свойствам. Иногда могут возникнуть ситуации, когда нужный критерий построить невозможно, однако, используя известную центральную предельную теорему, мы строим критерий, асимптотически стремящийся к необходимому. Здесь вы узнаете, что такое асимптотический уровень значимости, метод отношения правдоподобия, и как строятся критерий Бартлетта и критерий независимости хи-квадрат.

Линейная модель

Эту главу можно рассматривать как дополнение, а именно, применение статистики в случае линейной регрессии. Вы разберетесь в том, какие оценки хороши и в каких условиях. Вы узнаете, откуда взялся метод наименьших квадратов, каким образом строить критерии и зачем нужно F-распределение.

ЭФФЕКТИВНОСТЬ АСИМПТОТИЧЕСКАЯ КРИТЕРИЯ

Понятие, позволяющее осуществлять в случае больших выборок количественное двух различных статистич. критериев, применяемых для проверки ложной и той же статистич. гипотезы. Необходимость измерять эффективность критериев возникла в 30-40-е гг., когда появились простые с точки зрения вычислений, но лнеэффективные

Математическая энциклопедия. — М.: Советская энциклопедия.

И. М. Виноградов.

1977-1985.

Смотреть что такое «ЭФФЕКТИВНОСТЬ АСИМПТОТИЧЕСКАЯ КРИТЕРИЯ» в других словарях:

Коэффициент корреляции

— (Correlation coefficient) Коэффициент корреляции это статистический показатель зависимости двух случайных величин Определение коэффициента корреляции, виды коэффициентов корреляции, свойства коэффициента корреляции, вычисление и применение… … Энциклопедия инвестора

Методы математич. статистики, не предполагающие знания функционального вида генеральных распределений. Название непараметрические методы подчеркивает их отличие от классических параметрических методов, в к рых предполагается, что генеральное… … Математическая энциклопедия

Процесс представления информации в определенной стандартной форме и обратный процесс восстановления информации по ее такому представлению. В математич. литературе кодированием наз. отображение произвольного множества Ав множество конечных… … Математическая энциклопедия

Глоссарий

К разделу 7

Автоковариация (autocovariance) — для стационарного ряда Xt

ковариация случайных величинXt9 Xt+T9 у(т) Cov(Xn Xt+T).

Автокорреляционная функция {autocorrelation Junction -ACF) —

для стационарного рядаXt — последовательность его автокорреляций р(т) =

Corr(Xt9 Xt+ г), г = 0,1, 2,…

Автокорреляция (autocorrelation), коэффициент автокорреляции

(autocorrelation coefficient) — для стационарного ряда Xt коэффициент корреляции

случайных величин Хп Xt+T, р(т) = Corr(Xt, Xt+T).

Белый шум (white noise), процесс белого шума (white noise

process) — стационарный случайный процесс Xt с нулевым средним и ненулевой

дисперсией,

для которого Corr(Xt, Xs) = 0 при t Ф s.

«Более экономные» модели (more parsimonious models) — среди

некоторой совокупности альтернативных моделей временного ряда модели с

наименьшим количеством коэффициентов, подлежащих оцениванию.

Временной ряд (time series) — ряд значений некоторой

переменной, измеренных в последовательные моменты времени. Под временным рядом

понимается также случайный процесс с дискретным временем (случайная

последовательность), реализацией которого является наблюдаемый ряд значений.

Выборочная автокорреляционная функция (SACF — sample ACF) — последовательность

выборочных автокорреляций г (к), & = 0, 1,2,строящихся

по имеющейся

реализации временного ряда. Анализ этой последовательности помогает

идентифицировать процесс скользящего среднего и его порядок.

Выборочная частная автокорреляционная функция (SPACF-sample

PACF) — последовательность выборочных частных автокорреляций rpart(k), к = 0,

1, 2, строящихся по имеющейся реализации временного ряда. Анализ этой

последовательности помогает идентифицировать процесс скользящего среднего и его

порядок.

Выборочные автокорреляции {sample autocorrelations) — оценки

автокорреляций р(к) случайного процесса, построенные по имеющейся реализации

временного ряда. Один из вариантов оценки автокорреляции р{к) имеет вид:

T-kf?x » И)У t+k И) у (к) 1 т

где p = x = — ^xt — оценка для р = E{Xt), ] т-к

у (к) = y](xt p)(xt+k р) — оценка для автоковариации

у{к).

Выборочные частные автокорреляции {sample partial

autocorrelations) — оценки частных автокорреляций ррап{т) случайного процесса,

построенные по имеющейся реализации временного ряда.

Гауссовский белый шум {Gaussian white noise process) —

процесс белого шума, одномерные распределения которого являются нормальными

распределениями с нулевым математическим ожиданием.

Гауссовский случайный процесс {Gaussian process) — случайный

процесс, у которого для любого целого m > О и любого набора моментов времени

tx < t2 < … < tm совместные распределения случайных величин Xti, Xtm

являются m-мерными нормальными распределениями.

Инновация {innovation) — текущее значение случайной ошибки в

правой части соотношения, определяющего процесс авторегрессии Хг Инновация не

коррелирована с запаздывающими значениямиXt_k9 к= 1, 2, …

Последовательные значения инноваций (инновационная последовательность) образуют

процесс белого шума.

Информационный критерий Акаике {Akaike information criterion

— АІС) — один из критериев выбора «наилучшей» модели среди нескольких

альтернативных моделей. Среди альтернативных значений порядка модели

авторегрессии выбирается значение, которое минимизирует величину

о 2к А1С(£) = 1п0£2+у,

Оценка дисперсии инноваций єг в AR модели к-то порядка.

Критерий Акаике асимптотически переоценивает (завышает)

истинное значение к0 с ненулевой вероятностью.

Информационный критерий Хеннана — Куинна (Hannan-Quinn

information criterion — HQC) — один из критериев выбора «наилучшей» модели

среди нескольких альтернативных моделей. Среди альтернативных значений порядка

модели авторегрессии выбирается значение, которое минимизирует величину

UQ(k) = In а2к + к — ,

где Т — количество наблюдений;

(т£ — оценка дисперсии инноваций st в AR модели

А>го порядка.

Критерий обладает достаточно быстрой сходимостью к истинному

значению к0 при Т -» оо. Однако при небольших значениях Т этот критерий недооценивает

порядок авторегрессии.

Информационный критерий Шварца (Schwarz information

criterion — SIC) — один из критериев выбора «наилучшей» модели среди нескольких

альтернативных моделей. Среди альтернативных значений порядка модели

авторегрессии выбирается значение, которое минимизирует величину

SIC(£) = lno>2+Ar-,

где Т — количество наблюдений;

а? — оценка дисперсии инноваций st в AR модели А:-го

порядка.

Коррелограмма (correlogram) — для стационарного ряда: график

зависимости значений автокорреляций р(т) стационарного ряда от т.

Коррелограммой называют также пару графиков, приводящихся в протоколах анализа

данных в различных пакетах статистического анализа: графика выборочной

автокорреляционной функции и графика выборочной частной автокорреляционной функции.

Наличие этих двух графиков помогает идентифицировать модель ARMA, порождающую

имеющийся ряд наблюдений.

Обратный прогноз (backcasting) — прием получения более

точной аппроксимации условной функции правдоподобия при оценивании модели

скользящего среднего MA(q):

Xt = et + bxst_x + b2st_2 + … +

bqet_q9 bq Ф0,

по наблюдениям xl9 …, хт. Результат максимизации (no bx,

bl9 …, bq) условной функции правдоподобия, соответствующей наблюдаемым

значениям хХ9х29 …9хт при фиксированных значениях є09 є_Х9 є_д+Х9 зависит от

выбранных значений б*0, е_є_д+1. Если процесс MA(q) обратим, то можно положить

6*0 = є_х = … = s_q+x = 0. Но для улучшения качества оценивания можно методом

обратного прогноза «оценить» значения є09 е_Х9 є_д+х и использовать оцененные значения

в условной функции правдоподобия. Оператор запаздывания (lag operator — L)9

оператор обратного сдвига (back-shift operator) — оператор, определяемый

соотношением: LXt = Xt_x. Удобен для компактной записи моделей временных рядов

и для формулирования условий, обеспечивающих те или иные свойства ряда.

Например, с помощью этого оператора уравнение, определяющее модель ARMA(p, q)

Xt = Z ajxt-j + Z bj£t-j > <*Р*ъ>ъч* О,

может быть записано в виде: a(L) Xt = Ь(Ь)єп где

a(L) = 1 (axL + a2L2 + … + apLp

b(L)=l+blL + b2L2 + … + bqLq.

Проблема общих множителей (common factors) — наличие общих

множителей у многочленов a(L) и b(L)9 соответствующих AR и МА составляющим

модели ARMA:

Наличие общих множителей в спецификации модели ARMA

затрудняет практическую идентификацию модели по ряду наблюдений.

Процесс авторегрессии первого порядка (first-order

autoregressive process, AR(1)) — случайный процесс, текущее значение которого

является суммой линейной функции от запаздывающего на один шаг значения

процесса и случайной ошибки, не коррелированной с прошлыми значениями процесса.

При этом последовательность случайных ошибок образует процесс белого шума.

Процесс авторегрессии порядка р (pth-order autoregressive

process — AR(p)) — случайный процесс, текущее значение которого является суммой

линейной функции от запаздывающих на р шагов и менее значений процесса и

случайной ошибки, не коррелированной с прошлыми значениями процесса. При этом

последовательность случайных ошибок образует процесс белого шума.

Процесс скользящего среднего порядка q (qth-order moving

average process — MA(g)) — случайный процесс, текущее значение которого

является линейной функцией от текущего значения некоторого процесса белого шума

и запаздывающих на р шагов и менее значений этого процесса белого шума.

Разложение Вольда (Wold»s decomposition) — представление

стационарного в широком смысле процесса с нулевым математическим ожиданием в

виде суммы процесса скользящего среднего бесконечного порядка и линейно

детерминированного процесса.

Сезонная авторегрессия первого порядка (SAR(l) — first order

seasonal auto-regression) — случайный процесс, текущее значение которого

является линейной функцией от запаздывающего на S шагов значения этого процесса

и случайной ошибки, не коррелированной с прошлыми значениями процесса. При этом

последовательность случайных ошибок образует процесс белого шума. Здесь S = 4

для квартальных данных, S = 12 для месячных данных.

Сезонное скользящее среднее первого порядка (SMA(l) — first

order seasonal moving average) — случайный процесс, текущее значение которого

равно сумме линейной функции от текущего значения некоторого процесса белого

шума и запаздывающего на S шагов значения этого процесса белого шума. При этом

последовательность случайных ошибок образует процесс белого шума. Здесь 5 = 4

для квартальных данных, 5=12 для месячных данных.

Система уравнений Юла — Уокера (Yule — Walker equations) —

система уравнений, связывающая автокорреляции стационарного процесса

авторегрессии порядка р с его коэффициентами. Система позволяет последовательно

находить значения автокорреляций и дает возможность, используя первые р

уравнений, выразить коэффициенты стационарного процесса авторегрессии через

значения первых р автокорреляций, что можно непосредственно использовать при

подборе модели авторегрессии к реальным статистическим данным.

Случайный процесс с дискретным временем (discrete-time

stochastic process, discrete-time random process) — последовательность

случайных величин, соответствующих наблюдениям, произведенным в

последовательные моменты времени, имеющая определенную вероятностную структуру.

Смешанный процесс авторегрессии — скользящего среднего,

процесс авторегрессии с остатками в виде скользящего среднего (autoregressive

moving average, mixed autoregressive moving average — ARMA(p, q)) — случайный

процесс, текущее значение которого является суммой линейной функции от

запаздывающих на р шагов и менее значений процесса и линейной функции от

текущего значения некоторого процесса белого шума и запаздывающих на q шагов и

менее значений этого процесса белого шума.

Статистика Бокса — Пирса (Box-Pierce Q-statistic) — один из

вариантов g-ста-тистик:

Є = г£г2(*),

Статистика Люнга — Бокса (Ljung-Box Q-statistic) — один из

вариантов g-ста-тистик, более предпочтительный по сравнению со статистикой

Бокса — Пирса:

где Т — количество наблюдений; г (к)- выборочные

автокорреляции.

Используется для проверки гипотезы о том, что наблюдаемые

данные являются реализацией процесса белого шума.

Стационарный в широком смысле (wide-sense stationary), слабо

стационарный (weak-sense stationary, weakly stationary), стационарный второго

порядка (second-order stationary), ковариационно стационарный

(covari-ance-stationary) случайный процесс (stochastic process) — случайный

процесс с постоянным математическим ожиданием, постоянной дисперсией и

инвариантными по гковариациями случайных величинXt,Xt+T:

Cov(Xt,Xt+T) = r(r).

Строго стационарный, стационарный в узком смысле (strictly

stationary, strict-sense stationary) случайный процесс (stochastic process) —

случайный процесс с инвариантными по г совместными распределениями случайных

величинXh+T, …,+Т.

Условие обратимости процессов MA(q) и ARMA(p, q)

(invertibility condition) — для процессов Xt вида MA(g): Xt = b(L)st или

ARMA(p, q): a(L)(Xt ju) = = b(L)st — условие на корни уравнения b(z) = О,

обеспечивающее существование эквивалентного представления процесса Xt в виде

процесса авторегрессии бесконечного порядка AR(oo):

Условие обратимости: все корни уравнения b(z) = О лежат вне

единичного круга |z| < 1.

Условие стационарности процессов AR(p) и ARMA(p, q)

(stationarity condition) — для процессов Xt вида AR(p): a(L)(Xt ju) = et или

ARMA(p, q) a(L)(Xt ju) = = b(L)st — условие на корни уравнения a(z) = 0,

обеспечивающее стационарность процесса Хг Условие стационарности: все корни

уравнения b(z) = О лежат вне единичного круга |z| < 1. Если многочлены a(z)

и b(L) не имеют общих корней, то это условие является необходимым и достаточным

условием стационарности процесса Хг

Частная автокорреляционная функция (PACF — partial

autocorrelation function) — для стационарного ряда последовательность частных

автокорреляций ррап(г), т = 0, 1,2,…

Частная автокорреляция (РАС — partial autocorrelation) — для

стационарного ряда значение ppart(r) коэффициента корреляции между случайными

величинами Xt nXt+k, очищенными от влияния промежуточных случайных величин

Xt+l9…9Xt+k_Y.

Этап диагностики модели (diagnostic checking stage) —

диагностика оцененной модели ARMA, выбранной на основании имеющегося ряда

наблюдений.

Этап идентификации модели (identification stage) — выбор

модели порождения ряда на основании имеющегося ряда наблюдений, определение

порядков р и q модели ARMA.

Этап оценивания модели {estimation stage) — оценивание

коэффициентов модели ARMA, подобранной на основании имеющегося ряда наблюдений.

(7-статистики (Q-statistics) — статистики критериев,

используемых для проверки гипотезы о том, что наблюдаемые данные являются

реализацией процесса белого шума.

К разделу 8

Векторная авторегрессия порядкар (ph-order vector

autoregression — VAR(p)) — модель порождения группы временных рядов, в которой

текущее значение каждого ряда складывается из постоянной составляющей, линейных

комбинаций запаздывающих (до порядка р) значений данного ряда и остальных рядов

и случайной ошибки. Случайные ошибки в каждом уравнении не коррелированы с

запаздывающими значениями всех рассматриваемых рядов. Случайные векторы,

образованные ошибками в разных рядах в один и тот же момент времени, являются

независимыми, одинаково распределенными случайными векторами, имеющими нулевые

средние.

Долговременная (long-run) связь — устанавливающаяся с

течением времени определенная связь между переменными, по отношению к которой

происходят достаточно быстрые осцилляции.

Долгосрочные мультипликаторы (long-run multipliers,

equilibrum multipliers) — в динамической модели с авторегрессионно

распределенными запаздываниями — коэффициенты сх,cs долгосрочной зависимости

переменной от экзогенных переменных хи, xst. Коэффициент Cj отражает изменение

значения yt при изменении на единицу текущего и всех предыдущих значений переменной

xjt.

Импульсные мультипликаторы (impact multiplier, short-run

multiplier) — в динамической модели с авторегрессионно распределенными

запаздываниями — величины, показывающие влияние единовременных (импульсных)

изменений значений экзогенных переменных хи, xst на текущее и последующие

значения переменной jr

Кросс-ковариации (cross-covariances) — коэффициенты

корреляции между значениями разных компонент векторного ряда в совпадающие или

несовпадающие моменты времени.

Кросс-ковариационная функция (cross-covariance function) —

последовательность кросс-корреляций двух компонент стационарного векторного

ряда.

Модели с авторегрессионно распределенными запаздываниями

(autoregressive distributed lag models — ADL) — модели, в которых текущее

значение объясняемой переменной является суммой линейной функции от нескольких

запаздывающих значений этой переменной, линейных комбинаций текущих и

нескольких запаздывающих значений объясняющих переменных и случайной ошибки.

Передаточная функция (transfer function) — матричная

функция, устанавливающая влияние единичных изменений в экзогенных переменных на

эндогенные переменные.

Процесс порождения данных (data generating process — DGP) —

вероятностная модель, в соответствии с которой порождаются наблюдаемые

статистические данные. Процесс порождения данных, как правило, неизвестен

исследователю, анализирующему данные. Исключением являются ситуации, когда

исследователь сам выбирает процесс порождения данных и получает искусственные

статистические данные, имитируя выбранный процесс порождения данных.

Статистическая модель (statistical model — SM) — выбранная

для оценивания модель, структура которой предположительно соответствует

процессу порождения данных. Выбор статистической модели производится на

основании имеющейся экономической теории, анализа имеющихся в распоряжении

статистических данных, анализа результатов более ранних исследований.

Стационарный векторный (АГ-мерный) ряд (K-dimensional

stationary time series) — последовательность случайных векторов размерности К,

имеющих одинаковые векторы математических ожиданий и одинаковые ковариационные

матрицы, для которой перекрестные корреляции (кросс-корреляции) между значением

к-й компоненты ряда в момент t и значением 1-й компоненты ряда в момент (t + s)

зависят только от s.

К разделу 9

Гипотеза единичного корня (UR — unit root hypothesis) —

гипотеза, формулируемая в рамках модели ARMA(^, q): a(L)Xt = b(L)cr Гипотеза о

наличии у авторегрессионного полинома a(L) модели ARMA хотя бы одного корня,

равного 1. При этом обычно предполагается, что у полинома a(L) отсутствуют

корни, по модулю меньшие 1.

Дифференцирование (differencing) — переход от ряда уровней

Xt к ряду разностей Xt Xt_v Последовательное дифференцирование ряда дает

возможность устранить стохастический тренд, имеющийся в исходном ряде.

Интегрированный порядка к (integrated of order к) ряд — ряд

Хп который не является стационарным или стационарным относительно

детерминированного тренда (т.е. не является TS-рядом) и для которого ряд,

полученный в результате ^-кратного дифференцирования ряда Хп является

стационарным, но ряд, полученный в результате (к 1)-кратного

дифференцирования рядаХг, не является ГЯ-рядом.

Коинтеграционная связь (cointegration) — долгосрочная связь

между несколькими интегрированными рядами, характеризующая равновесное

состояние системы этих рядов.

Модель коррекции ошибок (error-correction model) —

комбинация краткосрочной и долгосрочной динамических регрессионных моделей при

наличии коинтеграционной связи между интегрированными рядами.

Оператор дифференцирования (difference operator) — оператор

А, переводящий ряд уровней Xt в ряд разностей:

Передифференцированный ряд (overdifferenced time series) —

ряд, полученный в результате дифференцирования Г5-ряда. Последовательное

дифференцирование ГО-ряда помогает устранить детерминированный полиномиальный

тренд. Однако дифференцирование Г^-ряда имеет некоторые нежелательные

последствия при подборе модели по статистическим данным и использовании

подобранной модели для целей прогнозирования будущих значений ряда.

Разностно стационарные, ЛУ-ряды (DS — difference stationary

time series) — интегрированные ряды различных порядков к= 1,2, … Приводятся к

стационарному ряду однократным или многократным дифференцированием, но не могут

приводиться к стационарному ряду вычитанием детерминированного тренда.

Ряд типа ARIMA(p, A, q) (ARIMA — autoregressive integrated

moving average) — временной ряд, который в результате ^-кратного

дифференцирования приводится к стационарному ряду ARMA(p, q).

Ряды, стационарные относительно детерминированного тренда,

Г5-ряды

(TS — trend-stationary time series) — ряды, становящиеся

стационарными после вычитания из них детерминированного тренда. В класс таких

рядов включаются и стационарные ряды без детерминированного тренда.

Случайное блуждание, процесс случайного блуждания (random

walk) — случайный процесс, приращения которого образуют процесс белого шума:

AXt st, так что Xt = Xt_ х + єг

Случайное блуждание со сносом, случайное блуждание с дрейфом

(random walk with drift) — случайный процесс, приращения которого являются

суммой константы и процесса белого шума: AXt = Xt Xt_ х = а + st, так что Xt

= Xt_x + а + єг Константа а характеризует постоянно присутствующий при переходе

к следующему моменту времени снос траекторий случайного блуждания, на который

накладывается случайная составляющая.

Стохастический тренд (stochastic trend) — временной ряд Zt,

для которого

Z, = єх + є2 + … + et. Значение случайного блуждания в

момент t равно t

Xt = Х0 + ^ є8, так что Xt Х0 = єх + є2 + … + єг Иными

словами, модель

стохастического тренда — процесс случайного блуждания,

«выходящего из начала координат» (для него Х0 = 0).

Шок инновации (shock innovation) — единовременное

(импульсное) изменение инновации.

Эффект Слуцкого (Slutsky effect) — эффект образования ложной

периодичности при дифференцировании ряда, стационарного относительно

детерминированного тренда. Например, если исходный ряд представляет собой сумму

детерминированного линейного тренда и белого шума, то продифференцированный ряд

не имеет детерминированного тренда, но оказывается автокоррелированным.

^-гипотеза (TS hypothesis) — гипотеза о том, что

рассматриваемый временной ряд является стационарным или рядом, стационарным

относительно детерминированного тренда.

К разделу 10

Долговременная дисперсия (long-run varance) — для ряда щ с

нулевым математическим ожиданием определяется как предел

Var(ux +… + ит)

Г-юс Т T-+OD

Критерии Дики — Фуллера (Dickey-Fuller tests) — группа

статистических критериев для проверки гипотезы единичного корня в рамках

моделей, предполагающих нулевое или ненулевое математическое ожидание

временного ряда, а также возможное наличие у ряда детерминированного тренда.

При применении критериев Дики — Фуллера чаще всего

оцениваются статистические модели

рAxt = а + (3t + cpxt_x + +є*> t = P + h—,T,

Axt =a + cpxt_x + ^0jAxt_j +£*, t =

/7 + 1,…, Г,

Axt = cpxt_x + ]T 6j Axt_j +єп t = p +1,…, T.

Полученные при оценивании этих статистических моделей

значения /-статистик / для проверки гипотезы Н0: ср = О сравниваются с

критическими значениями /крит, зависящими от выбора статистической модели.

Гипотеза единичного корня отвергается, если f < /крит.

Критерий Квятковского — Филлипса — Шмидта — Шина (KPSS test)

— критерий для различения DSи Г5-рядов, в котором в качестве нулевой берется

га-гипотеза.

Критерий Лейбурна (Leybourne test) — критерий для проверки

гипотезы единичного корня, статистика которого равна максимальному из двух

значений статистики Дики — Фуллера, полученных по исходному ряду и по ряду с

обращенным временем.

Критерий Перрона (Perron test) — критерий для проверки

нулевой гипотезы о принадлежности ряда классу DS, обобщающий процедуру Дики —

Фуллера на ситуации, когда на периоде наблюдений имеются структурные изменения

модели в некоторый момент времени Тв в форме либо сдвига уровня (модель

«краха»), либо изменения наклона тренда (модель «изменения роста»), либо

сочетания этих двух изменений. При этом предполагается, что момент Тв

определяется экзогенным образом — в том смысле, что он не выбирается на

основании визуального исследования графика ряда, а связывается с моментом

известного масштабного изменения экономической обстановки, существенно

отражающегося на поведении рассматриваемого ряда.

Гипотеза единичного корня отвергается, если наблюдаемое

значение статистики ta критерия оказывается ниже критического уровня, т.е. если

Асимптотические распределения и критические значения для

статистик ta9 первоначально приведенные Перроном, верны для моделей с

инновационными выбросами.

Критерий Филлипса — Перрона (Phillips-Perron test) —

критерий, сводящий проверку гипотезы о принадлежности ряда xt классу DS-рядов к

проверке гипотезы Я0: ср= О в рамках статистической модели

SM: kxt=a + f3t + (pxt_x+un t = 2,…,T,

где, как и в критерии Дики — Фуллера, параметры an рмогут

быть взяты равными нулю.

Однако в отличие от критерия Дики — Фуллера к рассмотрению

допускается более широкий класс временных рядов.

Критерий основывается на Г-статистике для проверки гипотезы

Н0: <р = О, но использует вариант этой статистики Zn скорректированный на

возможную автокоррелированность и гетероскедастичность ряда иг

Критерий Шмидта — Филлипса (Schmidt-Phillips test) —

критерий для проверки гипотезы единичного корня в рамках модели

где wt = jSwt_x + st; t — 2,Г;

у/ — параметр, представляющий уровень; £ — параметр,

представляющий тренд.

Критерий DF-GLS (DF-GLS test) — критерий, асимптотически

более мощный, чем критерий Дики — Фуллера.

Куртозис (kurtosis) — коэффициент пикообразности

распределения.

Модель аддитивного выброса (additive outlier) — модель, в

которой при переходе через дату излома Тв ряд yt сразу начинает осциллировать

вокруг нового уровня (или новой линии тренда).

Модель инновационного выброса (innovation outlier) — модель,

в которой после перехода через дату излома Тв процесс yt лишь постепенно

выходит на новый уровень (или к новой линии тренда), вокруг которого начинает

происходить осцилляция траектории ряда.

Многовариантная процедура проверки гипотезы единичного корня

(Dolado, Jenkinson, Sosvilla-Rivero) — формализованная процедура использования

критериев Дики — Фуллера с последовательной проверкой возможности редукции

исходной статистической модели, в качестве которой рассматривается модель

РAxt = а + fit +

(pxt_x + ^0jAxt-j +£7> t = P + h—9T.

Предпосылкой для использования формализованной

многовариантной процедуры является низкая мощность критериев единичного корня.

В связи с этим в многовариантной процедуре предусмотрены повторные проверки гипотезы

единичного корня в более простых моделях с меньшим числом оцениваемых

параметров. Это увеличивает вероятность правильного отвержения гипотезы

единичного корня, но сопровождается потерей контроля над уровнем значимости

процедуры.

Обобщенный критерий Перрона (generalized Perron test) —

предложенный Зиво-том и Эндрюсом (относящийся к инновационным выбросам)

безусловный критерий, в котором датировка точки смены режима производится в

«автоматическом режиме», путем перебора всех возможных вариантов датировки и

вычисления для каждого варианта датировки /-статистики ta для проверки гипотезы

единичного корня; в качестве оцененной даты берется такая, для которой значение

ta оказывается минимальным.

Процедура Кохрейна, отношение дисперсий (variance ratio

test) — процедура различения TSи /)5-рядов, основанная на специфике поведения

для этих

рядов отношения VRk = -, где Vk = -D(Xt -Xt_k).

Стандартное броуновское движение (standard Brownian motion)

— случайный процесс W(r) с непрерывным временем, являющийся непрерывным

аналогом дискретного случайного блуждания. Это процесс, для которого:

приращения (W(r2) W(r{)),(W(rk) W(rk_x)) независимы в

совокупности, если 0 < rx < г2 < … < гк и W(s) W(r) ~ N(0, s г) при s > г;

реализации процесса W(r) непрерывны с вероятностью 1.

Ширина окна (window size) — количество выборочных

автоковариаций ряда, используемых в оценке Ньюи — Веста для долговременной

дисперсии ряда. Недостаточная ширина окна ведет к отклонениям от номинального

размера критерия (уровня значимости). В то же время увеличение ширины окна, для

того чтобы избежать отклонений от номинального размера критерия, ведет к

падению мощности критерия.

Двумерный гауссовский белый шум (two-dimentional Gaussian

white noise) — последовательность независимых, одинаково распределенных

случайных векторов, имеющих двумерное нормальное распределение с нулевым

математическим ожиданием.

Детерминистская коинтеграция (stochastic cointegration) —

существование для группы интегрированных рядов их линейной комбинации,

аннулирующей стохастический и детерминированный тренды. Ряд, представляемый

этой линейной комбинацией, является стационарным.

Идентификация коинтегрирующих векторов (identification of

the cointegrating vectors) — выбор базиса коинтеграционного пространства,

состоящего из коинтегрирующих векторов, имеющих разумную экономическую

интерпретацию.

Коинтеграционное пространство (cointegrating space) —

совокупность всех возможных коинтегрирующих векторов для коинтегрированной

системы рядов.

Коинтегрированные временные ряды, коинтегрированные в узком

смысле временные ряды (cointegrated time series) — группа временных рядов, для

которой существует нетривиальная линейная комбинация этих рядов, являющаяся

стационарным рядом.

Коинтегрирующий вектор (cointegrating vector) — вектор

коэффициентов нетривиальной линейной комбинации нескольких рядов, являющейся

стационарным рядом.

Критерий максимального собственного значения (maximum

eigenvalue test) — критерий, который в процедуре Йохансена оценивания ранга

коинтеграции г системы интегрированных (порядка 1) рядов используется для

проверки гипотезы Н0:г = г* против альтернативной гипотезы НА: г = г* + 1.

Критерий следа (trace test) — критерий, который в процедуре

Йохансена оценивания ранга коинтеграции г системы интегрированных (порядка 1)

рядов используется для проверки гипотезы Н0: г = г* против альтернативной

гипотезы НА:г> г*.

Общие тренды (common trends) — группа рядов, управляющих

стохастической нестационарностью системы коинтегрированных рядов.

Причинность по Грейнджеру (Granger causality) — факт

улучшения качества прогноза значения yt переменной Y в момент t по совокупности

всех прошлых значений этой переменной при учете прошлых значений некоторой

другой переменной.

Пять ситуаций в процедуре Йохансена — пять ситуаций, от

которых зависят критические значения статистик критериев отношения

правдоподобий, используемых в процедуре Йохансена оценивания ранга коинтеграции

системы интегрированных (порядка 1) рядов:

Н2(г): в данных нет детерминированных трендов, в СЕ не

включаются ни константа, ни тренд;

Н*(г): в данных нет детерминированных трендов,

в СЕ включается константа, но не включается тренд;

Нх (г): в данных есть детерминированный линейный тренд, в СЕ

включается константа, но не включается тренд;

Н*(г) в данных есть детерминированный линейный тренд, в СЕ

включаются константа и линейный тренд;

Н(г): в данных есть детерминированный квадратичный тренд, в

СЕ включаются константа и линейный тренд.

(Здесь СЕ — коинтеграционное уравнение.)

При фиксированном ранге г перечисленные 5 ситуаций образуют

цепочку вложенных гипотез:

Н2(г) с Н*(г) с Я, (г) с Нг) с Н{г).

Это дает возможность, используя критерий отношения

правдоподобий, проверять выполнение гипотезы, стоящей левее в этой цепочке, в

рамках гипотезы, расположенной непосредственно справа.

Ранг коинтеграции (cointegrating rank) — максимальное

количество линейно независимых коинтегрирующих векторов для заданной группы

рядов, ранг коинтеграционного пространства.

Стохастическая коинтеграция (stochastic cointegration) —

существование для группы интегрированных рядов линейной комбинации,

аннулирующей стохастический тренд. Ряд, представляемый этой линейной

комбинацией, не содержит стохастического тренда, но может иметь

детерминированный тренд.

Треугольная система Филлипса (Phillips»s triangular system)

— представление системы TV коинтегрированных рядов с рангом коинтеграции г в

виде системы уравнений, первые г из которых описывают зависимость г выделенных

переменных от остальных (N г) переменных (общих трендов), а остальные

уравнения описывают модели порождения общих трендов.

TV-мерный гауссовский белый шум (N-dimentional Gaussian

white noise) — последовательность независимых, одинаково распределенных

случайных векторов, имеющих TV-мерное нормальное распределение с нулевым

математическим ожиданием.

Exact Tests provides two additional methods for calculating significance

levels for the statistics available through the Crosstabs and Nonparametric

Tests procedures. These methods, the exact and Monte Carlo methods,

provide a means for obtaining accurate results when your data fail

to meet any of the underlying assumptions necessary for reliable results

using the standard asymptotic method. Available only if you have purchased

the Exact Tests Options.

Example.

Asymptotic results obtained from small datasets or sparse or unbalanced

tables can be misleading. Exact tests enable you to obtain an accurate

significance level without relying on assumptions that might not be

met by your data. For example, results of an entrance exam for 20

fire fighters in a small township show that all five white applicants

received a pass result, whereas the results for Black, Asian and Hispanic

applicants are mixed. A Pearson chi-square testing the null hypothesis

that results are independent of race produces an asymptotic significance

level of 0.07. This result leads to the conclusion that exam results

are independent of the race of the examinee. However, because the

data contain only 20 cases and the cells have expected frequencies

of less than 5, this result is not trustworthy. The exact significance

of the Pearson chi-square is 0.04, which leads to the opposite conclusion.

Based on the exact significance, you would conclude that exam results

and race of the examinee are related. This demonstrates the importance

of obtaining exact results when the assumptions of the asymptotic

method cannot be met. The exact significance is always reliable, regardless

of the size, distribution, sparseness, or balance of the data.

Statistics.

Asymptotic significance. Monte Carlo approximation with confidence

level, or exact significance.

- Asymptotic . The significance level based on the asymptotic

distribution of a test statistic. Typically, a value of less than

0.05 is considered significant. The asymptotic significance is based

on the assumption that the data set is large. If the data set is small

or poorly distributed, this may not be a good indication of significance. - Monte Carlo Estimate . An unbiased estimate of the exact significance

level, calculated by repeatedly sampling from a reference set of tables

with the same dimensions and row and column margins as the observed

table. The Monte Carlo method allows you to estimate exact significance

without relying on the assumptions required for the asymptotic method.

This method is most useful when the data set is too large to compute

exact significance, but the data do not meet the assumptions of the

asymptotic method. - Exact . The probability of the observed outcome or

an outcome more extreme is calculated exactly. Typically, a significance

level less than 0.05 is considered significant, indicating that there

is some relationship between the row and column variables.